Apple Siri × Google Gemini提携――iPhoneの音声アシスタントが根本から変わる

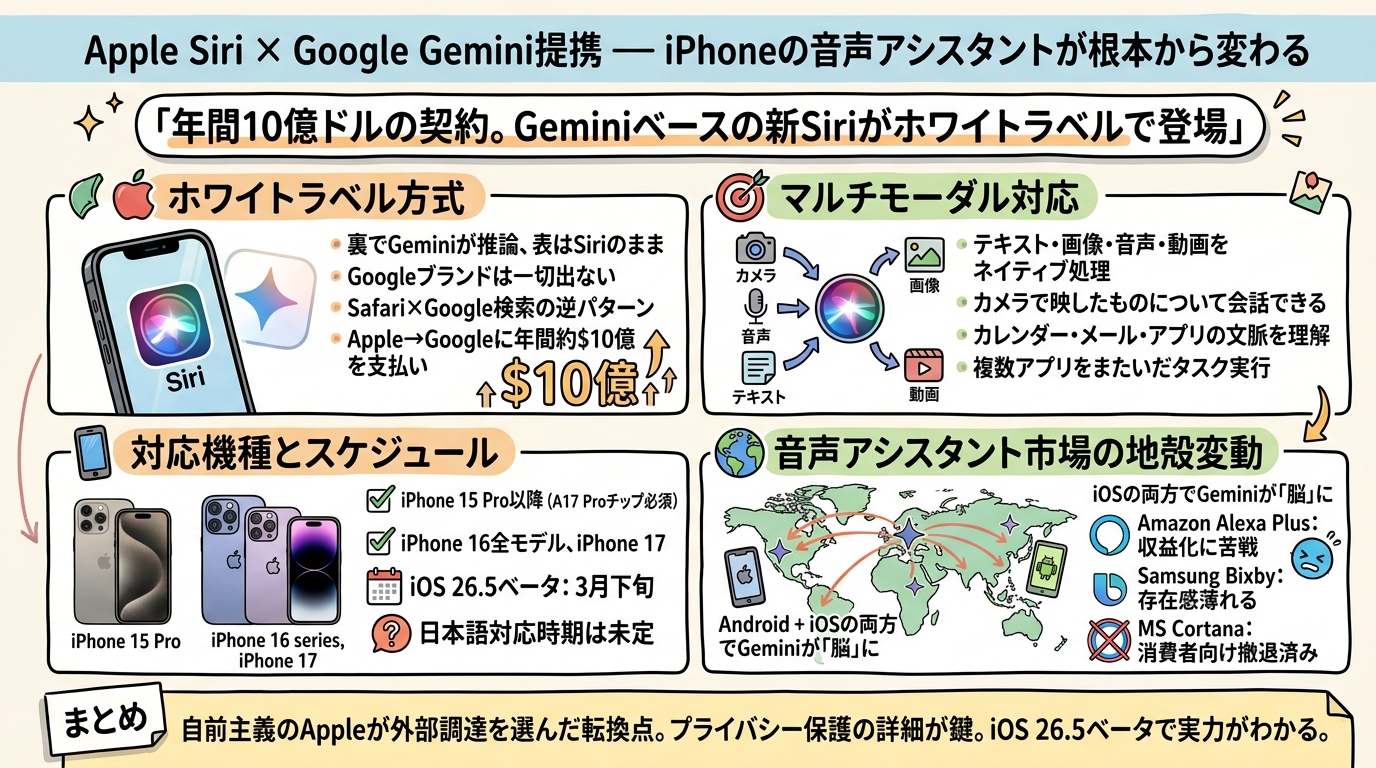

2026年1月12日、Apple は Google との提携を正式に発表した。内容は、Google の大規模言語モデル「Gemini」を Siri の基盤に据えるというもの。年間契約額はおよそ10億ドル。iPhone ユーザーの目には従来と同じ「Siri」として映るが、その中身はまったくの別物になる。

2024年6月の WWDC で Apple Intelligence が華々しく発表されたとき、多くの人が「Siri がようやく賢くなる」と期待した。あれから約1年半。率直に言えば、その約束はずっと宙に浮いていた。今回の Gemini 提携は、Apple がようやくその借りを返しに来た形だ。

「ホワイトラベル」という選択

今回の提携で最も目を引くのは、Gemini が「ホワイトラベル」として組み込まれる点だろう。ユーザーが Siri に話しかけると、裏では Gemini が推論を行い、結果を Siri のインターフェースで返す。Google のブランドは一切表に出ない。

この構造、どこかで見覚えがないだろうか。検索エンジンの世界で Apple と Google が長年続けてきた関係とよく似ている。Safari のデフォルト検索エンジンとして Google が採用され、Apple は年間数百億ドルのライセンス料を受け取ってきた。今回はその逆で、Apple が Google に年間約10億ドルを支払う側に回った。

ここで気になるのは、Apple のプライド——というより、戦略的なポジションの問題だ。自社でモデルを開発する力がないわけではない。Apple Silicon の Neural Engine は年々強化されているし、オンデバイス AI の小規模モデルもすでに動いている。それでも、クラウド側の大規模推論では Google に頼る判断を下した。自前主義で知られる Apple にしては珍しい動きである。

もっとも、ユーザーから見れば「中身が何で動いているか」は大した問題ではない。Siri が賢くなるなら、それでいい。Apple が気にしているのもおそらくそこで、ブランド体験さえ自社でコントロールできれば、エンジンは外部調達でも構わないという割り切りが透けて見える。

マルチモーダルで何が変わるのか

新しい Siri は、テキスト・画像・音声・動画をネイティブに処理するマルチモーダル対応になる。これまでの Siri が「音声でコマンドを受け取り、テキストベースで処理する」仕組みだったのに対し、根本的な設計思想が変わった。

具体的に想像してみよう。レストランのメニューを iPhone のカメラで映しながら「この中でグルテンフリーのものはどれ?」と聞く。画面に表示されている資料を見せて「この表の数字、前月比でおかしいところある?」と尋ねる。こうした「見ているものについて話す」体験が、ようやく Siri でも実現しうる。

加えて、ユーザーの個人データやオンスクリーンコンテンツへのアクセスも可能になるという。カレンダー、メール、メッセージ、今画面に表示されているアプリの内容——これらを文脈として理解したうえでタスクを遂行する。「明日の会議の資料、昨日メールで受け取ったやつを開いて」といった指示が、複数のアプリをまたいで処理される世界だ。

正直なところ、ここまでの話はデモや発表資料レベルでは何度も聞いてきた。Google 自身も Google アシスタントで似たビジョンを掲げてきたし、OpenAI の ChatGPT も同様の方向を目指している。問題は「実際にどこまで使えるか」であり、iOS 26.5 ベータが3月下旬に出てくるまでは判断を保留せざるを得ない。

対応機種と展開スケジュール

新 Siri の対応機種は以下のとおり。

- iPhone 15 Pro / iPhone 15 Pro Max

- iPhone 16シリーズ(全モデル)

- iPhone 17(2025年秋発売モデル)

iPhone 15 の無印・Plus は対象外となる。A17 Pro チップ以降が必要ということだろう。iPad や Mac への展開については、今のところ公式な言及はない。

展開スケジュールとしては、iOS 26.5 ベータが3月下旬に登場予定。正式リリースの時期は明言されていないが、例年のパターンからすれば、4月から5月にかけての一般公開が現実的なラインだろうか。

気になるのは地域展開だ。Apple Intelligence 自体、日本語対応は英語圏から遅れて段階的に進んできた経緯がある。Gemini ベースの新 Siri がどの言語から対応するのか。日本のユーザーにとっては、機能の有無よりもこちらのほうが切実な問題かもしれない。

Apple Intelligence の「約束」はどこまで果たされるか

2024年6月の WWDC で Apple Intelligence が発表されたとき、Craig Federighi は壇上でこう語った——Siri はパーソナルインテリジェンスシステムになる、と。あれから約1年半、Apple が出してきた答えは「自社開発」ではなく「Google との提携」だった。

この判断をどう見るかは立場によって分かれるだろう。Apple のエコシステムを重視する人にとっては、外部依存が増えることへの不安があるかもしれない。一方で、実用性を求めるユーザーにとっては、誰が作ったモデルかより「ちゃんと動くかどうか」が全てだ。

年間10億ドルという金額は、Apple の売上規模(2025年度で約3,900億ドル)からすれば大きな数字ではない。むしろ、自社で数千人規模の AI 研究チームを維持し、巨額の計算リソースを確保するコストと比べれば、合理的な投資に見える。Google にとっても、世界で20億台以上稼働する iPhone を通じて Gemini の推論回数を爆発的に増やせるメリットは計り知れない。

ただ、ひとつ引っかかる点がある。Apple は長年、プライバシーを最大の差別化要因として打ち出してきた。「あなたのデータはデバイスの中にある」というメッセージ。Gemini ベースの新 Siri では、クラウド側で推論が行われるケースが当然出てくる。Apple がどのようなプライバシー保護の仕組みを用意しているのか——Private Cloud Compute の拡張なのか、それとも別のアーキテクチャなのか——この点の詳細はまだ明らかになっていない。

音声アシスタント市場の地殻変動

今回の提携は、Apple と Google という2社の話にとどまらない。音声アシスタント市場全体の勢力図を塗り替える可能性がある。

Amazon の Alexa は、2024年から「Alexa Plus」として LLM ベースへの移行を進めてきたが、収益化に苦戦している。Samsung の Bixby は存在感が薄れる一方。Microsoft の Cortana はすでに消費者向けを撤退した。この状況で、世界最大のスマートフォンエコシステムに Google の最新モデルが載る。

構図を整理するとこうなる。Google は自社の Pixel で Gemini を直接提供しつつ、iPhone 経由でも Gemini を届ける。Android と iOS の両方で、Google の AI が音声アシスタントの「脳」として機能する世界。OpenAI の ChatGPT が急速にユーザーを増やしているとはいえ、OS レベルで組み込まれたアシスタントの影響力は桁違いだ。

Apple にとっての賭けは、「Gemini がコモディティ化したとき、自分たちが主導権を握っていられるか」という点に尽きる。検索エンジンの契約と同じように、将来的に別のモデルに乗り換える選択肢を残しているのか。それとも Google への依存が深まり、抜けられなくなるのか。

まとめ

Siri は2011年の登場以来、「期待されては裏切る」を繰り返してきたアシスタントだ。今回の Gemini 提携で、その評価が一変する可能性はある。ただし、あくまで「可能性」だ。

iOS 26.5 ベータが3月下旬に出れば、実際の使用感が見えてくる。マルチモーダル対応がどこまで実用的か、レスポンス速度はどうか、プライバシー保護の具体的な仕組みは何か。判断材料はこれから揃う。

年間10億ドルを投じた Apple の決断が正しかったかどうか、答えが出るのはもう少し先の話になる。

Sources:

- Apple picks Google's Gemini to run AI-powered Siri coming this year | CNBC

- Google's Gemini to power Apple's AI features like Siri | TechCrunch

- Joint statement from Google and Apple | Google Blog

- New details on Apple-Google AI deal revealed, including Gemini changes | 9to5Mac

- Here's When Apple Plans to Unveil a New Siri Powered by Google Gemini | MacRumors