GPT-5.4 vs Claude Opus 4.6 vs Gemini 3.1 Pro――2026年3月フロンティアAIモデル徹底比較

2026年3月、AIのフロンティアは三つ巴の状態にある。

OpenAIのGPT-5.4、AnthropicのClaude Opus 4.6、GoogleのGemini 3.1 Pro。いずれもベンチマークで互いに数ポイント差のスコアを叩き出し、「どれが最強か」を一言で断じるのが難しくなった。だが用途を絞れば、三者の個性は鮮明に浮かび上がる。

本記事では、推論・コーディング・知識労働・マルチモーダル・価格の5つの軸から、各モデルの強みと弱みを整理する。「結局どれを使えばいいのか」に対する現時点での回答を、数字を交えて示していきたい。

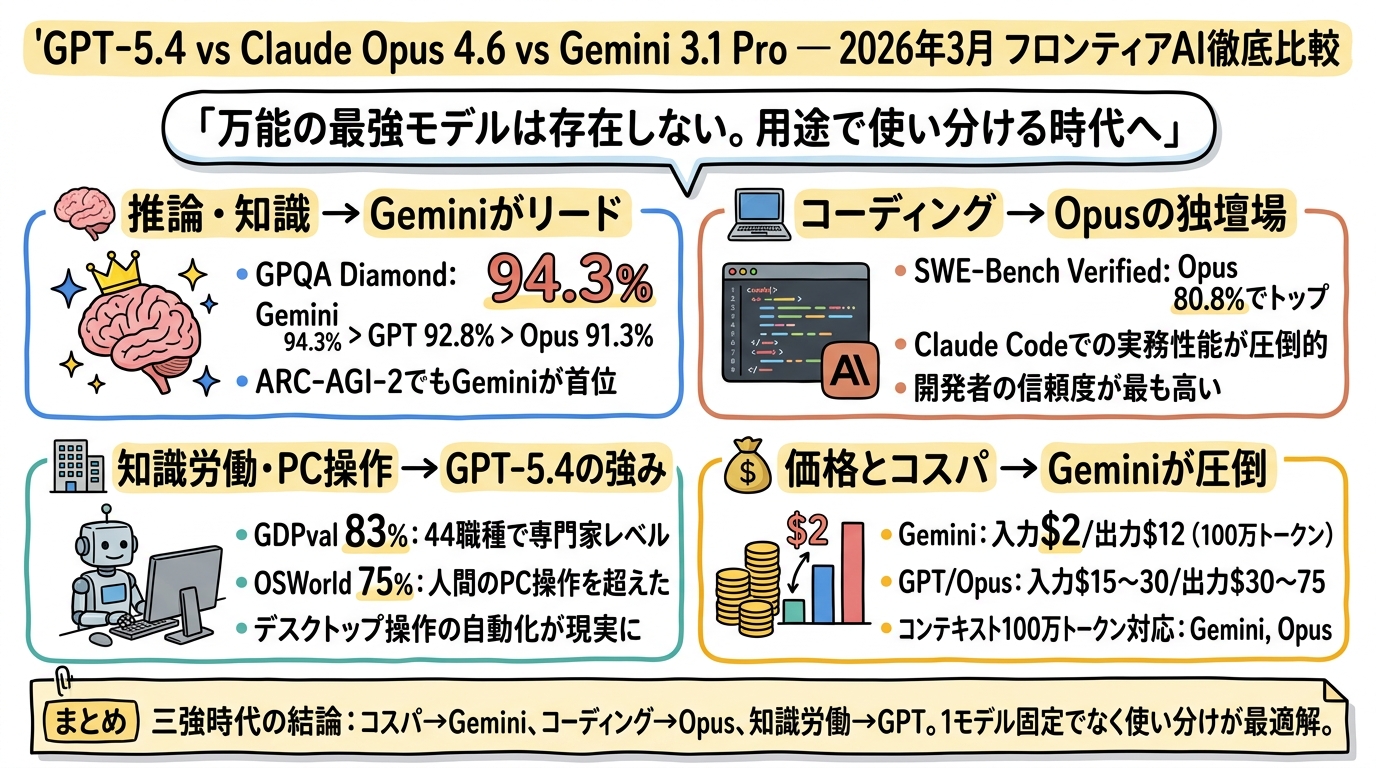

推論・知識ベンチマーク――Geminiがわずかにリード

学術的な推論能力を測るGPQA Diamondでは、Gemini 3.1 Proが94.3%でトップに立った。GPT-5.4が92.8%、Opus 4.6が91.3%と続く。約3ポイントの差は、日常的なプロンプトで体感できるかと問われると微妙なところだが、Geminiの推論エンジンが一歩先を行っている数字ではある。

より興味深いのがARC-AGI-2の結果だろう。汎用的な推論能力を測るこのベンチマークでも、Gemini 3.1 Proが77.1%で首位。Opus 4.6が75.2%、GPT-5.4が73.3%という並びだ。

| ベンチマーク | Gemini 3.1 Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|

| GPQA Diamond | 94.3% | 92.8% | 91.3% |

| ARC-AGI-2 | 77.1% | 73.3% | 75.2% |

個人的には、ARC-AGI-2でOpus 4.6がGPT-5.4を上回っている点が目を引く。GPQAでは3位だったOpusが、より抽象的な推論タスクでは逆転している。ベンチマークの性質によってモデルの「得意科目」が入れ替わるわけで、単一指標での比較がいかに不完全かを示す好例だ。

コーディング――Opus 4.6の独壇場

コーディング性能の比較に移ると、勢力図ががらりと変わる。

SWE-Bench Verifiedにおいて、Claude Opus 4.6は80.8%を記録した。プロンプト最適化を施した条件下では81.42%まで伸びる。Gemini 3.1 Proが80.6%で肉薄しているものの、Opus 4.6が単独トップの座を守っている。

0.2ポイント差をどう見るか。数字だけなら僅差に見えるが、SWE-Benchは実際のGitHubイシューを解決できるかを問うベンチマークであり、1ポイントの差が実務での信頼性に直結しやすい。開発者コミュニティでの評判を見ても、「複雑なコードベースの修正はOpusに任せる」という声が根強い。

率直に言えば、Opus 4.6のコーディング性能は単なるベンチマーク上の数字以上のものがある。Claude Codeとして実際にCLIで動かしたときの指示理解力、コンテキストの保持力、そして修正提案の的確さ。このあたりは数値化しにくいが、日常的に使っている開発者ほど差を感じやすいポイントだ。

GPT-5.4のSWE-Benchスコアは公開情報が限定的だが、推論ベンチマークほどの優位性はコーディング領域では発揮できていないようだ。OpenAIの強みは別のところにある。

知識労働とPC操作――GPT-5.4が見せる「現実世界」での強さ

GPT-5.4の真価が発揮されるのは、知識労働の自動化という領域だ。

OpenAIが独自に開発したGDPvalベンチマークで、GPT-5.4は83%を達成。これは44の職種において、その分野の専門家と同等のパフォーマンスを出せることを意味する。会計士、マーケティングアナリスト、法務リサーチャー。ホワイトカラーの業務領域にAIが「実用レベル」で踏み込んできた象徴的な数字と言っていい。

さらに衝撃的なのがOSWorldのスコアだ。PCの実操作タスクを評価するこのベンチマークで、GPT-5.4は75%を記録した。人間の平均を超えている。ブラウザの操作、ファイル管理、アプリケーション間の連携――こうした「マウスとキーボードで行う作業」を、AIが人間より正確にこなせるという結果が出ている。

ここで気になるのは、この「PC操作能力」がどこまで汎用的かという問題だ。ベンチマーク環境と実際のデスクトップは異なる。予期しないポップアップ、ネットワーク遅延、アプリのバージョン違い。実環境のカオスにどこまで耐えられるかは、もう少し検証が必要だろう。

それでも、「AIにPCを操作させる」という発想がベンチマーク上の実験段階を超えつつあることは確かだ。OpenAIがこの方向に大きくリソースを投じていることが、スコアから読み取れる。

マルチモーダル対応――Geminiだけが「全部入り」

マルチモーダル対応の比較は、実はもっともシンプルに差がつく領域だ。

Gemini 3.1 Proは、テキスト・画像・音声・動画のすべてをネイティブで扱える。「ネイティブ」というのがポイントで、外部ツールを噛ませるのではなく、モデル自体が複数のモダリティを統合処理できる。会議の録画を投げて要約させる、製品写真から仕様書を起こす、音声メモをテキスト化しながら関連画像を参照する――こうしたワークフローがシームレスに成立する。

一方、Claude Opus 4.6とGPT-5.4は画像入力のみの対応にとどまっている。テキストと画像の組み合わせであれば十分に高い精度を出すが、音声や動画を直接処理することはできない。

この差は、API経由で複合的なワークフローを組む場面で効いてくる。たとえばカスタマーサポートのチャットボットに音声通話の文字起こしと感情分析を統合させたい場合、Geminiなら1つのモデルで完結する。Claude・GPTの場合は、別途Whisperなどの音声認識モデルを組み合わせる必要がある。工数とレイテンシの両面で不利だ。

もっとも、「テキストと画像で十分」というユースケースは依然として多い。全ユーザーがマルチモーダルのフルスペックを必要とするわけではなく、ここは実際の業務要件次第で評価が分かれるところだろう。

価格とコンテキスト長――Geminiのコスパが圧倒的

性能が拮抗しているなら、価格が決め手になる場面は多い。ここでGemini 3.1 Proは強烈なアドバンテージを持っている。

Gemini 3.1 Proの料金は、入力$2/出力$12(100万トークンあたり)。 コンテキストウィンドウは100万トークン。

GPT-5.4やClaude Opus 4.6の正確な公開価格は利用プランによって変動するが、一般にフロンティアモデルの相場は入力$10〜30/出力$30〜60程度だ。Geminiの入力価格はこの5分の1から10分の1に相当する。

| Gemini 3.1 Pro | GPT-5.4 | Claude Opus 4.6 | |

|---|---|---|---|

| 入力(/1M tokens) | $2 | $15〜30 | $15 |

| 出力(/1M tokens) | $12 | $30〜60 | $75 |

| コンテキスト長 | 100万 | 12.8万〜 | 100万 |

100万トークンのコンテキストウィンドウを$2の入力単価で使える。大量のドキュメントを一括投入して分析するようなバッチ処理では、このコスト差は無視できないレベルになる。月間数百万リクエストを捌くプロダクションAPIなら、年間のコスト差は数千万円規模にのぼる可能性もある。

Opus 4.6もコンテキスト長では100万トークンに対応しているが、出力単価$75は3モデル中で最も高い。その分、コーディングやエージェント用途での品質に投資しているという見方もできるが、コスト最適化が最優先のプロジェクトにはGeminiを選ぶのが合理的だ。

用途別・モデル選定ガイド

ここまでの比較を踏まえて、用途別の推奨をまとめてみる。万能の「最強モデル」は存在しない、というのが2026年3月時点での率直な結論だ。

コスパ重視・大量処理 → Gemini 3.1 Pro

100万トークンのコンテキスト、$2/$12の価格、ネイティブマルチモーダル。RAG(検索拡張生成)パイプラインのバックエンドや、ドキュメント分析の大量バッチ処理など、「量をさばく」用途ではGemini一択に近い。推論性能もGPQA Diamond 94.3%でトップだから、品質を犠牲にしているわけでもない。

複雑なコーディング・AIエージェント → Claude Opus 4.6

SWE-Bench Verified 80.8%のスコアが示す通り、複雑なコードベースの理解と修正においてOpusは頭一つ抜けている。Claude Codeを使ったCLIベースの開発ワークフロー、あるいは自律的にタスクを遂行するAIエージェントの中核モデルとして、現時点で最も信頼できる選択肢だ。100万トークンのコンテキストも、大規模リポジトリの解析には有利に働く。

知識労働の自動化・デスクトップ操作 → GPT-5.4

44職種で専門家レベルのGDPval 83%、人間超えのOSWorld 75%。「AIに仕事を任せる」という文脈では、GPT-5.4が最も実績のあるモデルだ。特にデスクトップ操作を伴うRPA的なワークフローの自動化は、現時点でGPT-5.4にしかできない芸当に近い。Microsoft 365との統合も視野に入れれば、エンタープライズ環境での採用は加速するだろう。

「三強時代」のリアル

半年前であれば、「最強のLLMはどれか」という問いに1つの答えを出せたかもしれない。しかし2026年3月の現在、3社のモデルはそれぞれ異なる方向に尖り、異なる土俵でトップを取っている。

Geminiは汎用性とコストパフォーマンスで攻める。Opusはコーディングとエージェント性能で差別化する。GPT-5.4は知識労働と実世界操作で新境地を開く。

この「三強時代」がユーザーにとって何を意味するのか。答えは明快で、モデルを使い分ける時代が来たということだ。1つのモデルに固定するのではなく、タスクの性質に応じてAPIの向き先を切り替える。あるいは、オーケストレーション層を挟んで複数モデルを協調させる。そうしたアーキテクチャが、もはや実験的なものではなく実用的な選択になりつつある。

個人的には、この競争がさらに激化する2026年後半が楽しみだ。DeepSeek V4のようなオープンソース勢の台頭も含め、フロンティアの定義そのものが書き換わる可能性がある。今の3モデル比較は、半年後には「あの頃はまだシンプルだった」と振り返ることになるかもしれない。

どのモデルを選ぶにせよ、重要なのは自分のユースケースを正確に把握し、ベンチマークの数字を鵜呑みにせず、実際に試して判断すること。フロンティアAIの進化速度を考えれば、今日の最適解が来月も最適解である保証はどこにもない。

Sources:

- Introducing GPT-5.4 | OpenAI

- OpenAI launches GPT-5.4 with Pro and Thinking versions | TechCrunch

- GPT-5.4 vs Claude Opus 4.6 vs Gemini 3.1 Pro: Real Benchmark Results Compared | MindStudio

- AI Coding Benchmarks 2026: Claude vs GPT vs Gemini | byteiota

- The March 2026 Frontier: GPT-5.4 vs. Gemini 3.1 vs. Claude 4.6 | Medium