Anthropic「Claude Mythos」——データ漏洩で明らかになった次世代AIモデルの全貌

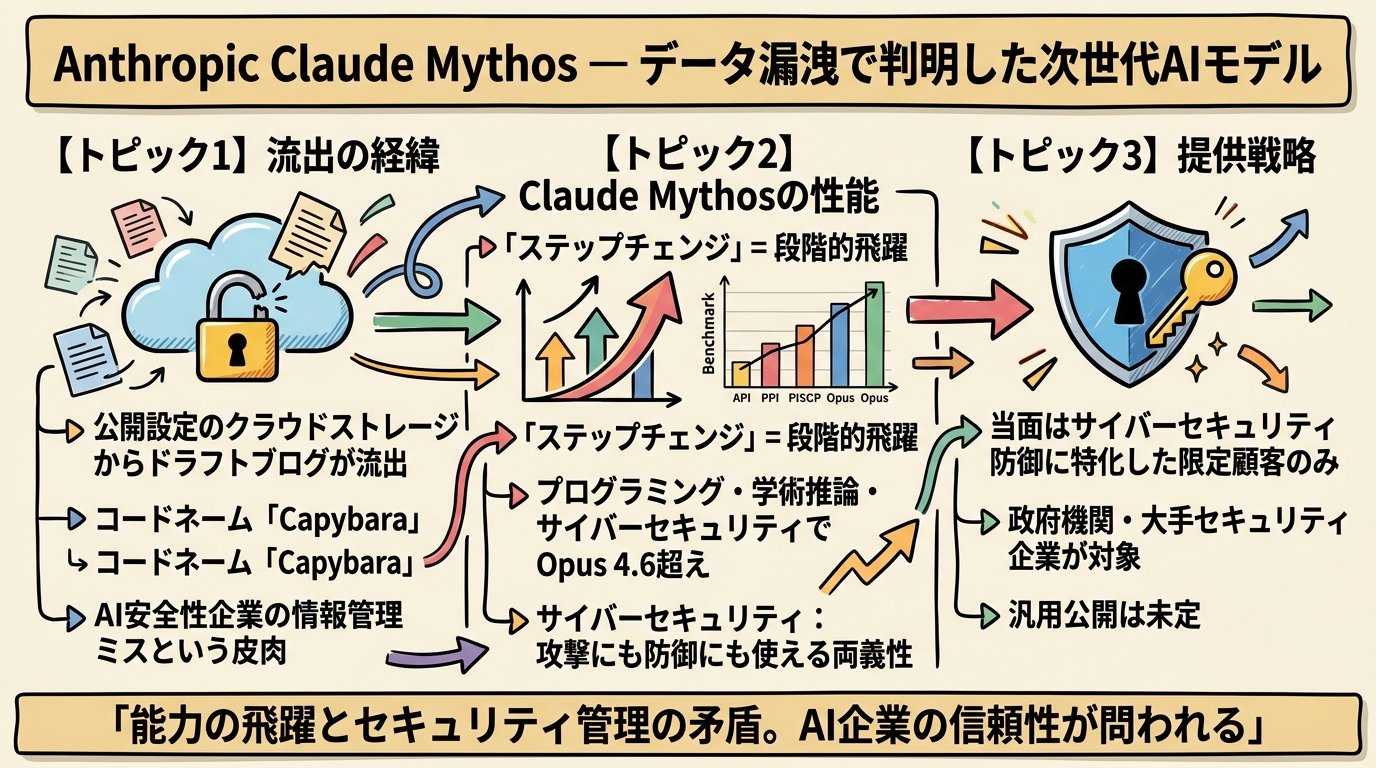

2026年3月25日、Anthropicが開発中の次世代AIモデル「Claude Mythos」の存在が、皮肉にもデータ漏洩によって世に知られることになった。公開設定になっていたクラウドデータストアから、同社のドラフトブログ記事が流出。そこにはコードネーム「Capybara」と呼ばれる新モデルの詳細が記されていた。

AIの安全性を最重要課題に掲げる企業が、自社の情報管理で躓く——正直なところ、この構図にはある種の教訓が含まれている。だが流出した内容自体は、AI業界の勢力図を塗り替えうるほどのインパクトを持っていた。

流出の経緯——公開設定のデータストアという初歩的ミス

今回の発覚は、セキュリティ研究者がAnthropicの関連インフラをスキャンしていた際に、認証なしでアクセス可能なクラウドストレージバケットを発見したことに端を発する。そこに保存されていたのは、Claude Mythosの発表用に準備されていたブログ記事のドラフト、技術仕様の概要、そして内部ベンチマーク結果の一部だった。

Anthropicはこの件について公式なコメントを控えているが、該当のデータストアは発覚から数時間以内にアクセス制限がかけられた。流出した情報の信憑性について否定はしていない。

個人的に気になるのは、これが「たまたま設定ミスがあった」だけの話なのか、それとも急速にスケールする組織で構造的に起きうる問題なのかという点だ。Anthropicは2025年後半から急激に人員を拡大しており、インフラ管理の複雑さも比例して増している。AI企業のセキュリティ体制は、モデルの能力と同じくらい重要なはずだが、そこに十分なリソースが割かれているかは外部からは見えにくい。

Claude Mythosの技術的なポイント

流出した資料から判明した内容を整理する。

まず、AnthropicはClaude Mythosを「ステップチェンジ(段階的飛躍)」と位置づけている。これは同社がこれまで使ってきた表現の中でも、かなり強い部類に入る。Claude 3.5からClaude 4への移行を「大幅な改善」と表現していたことを考えると、Mythosはそれ以上の進化を意味するのだろう。

具体的なベンチマーク結果では、ソフトウェアプログラミング、学術推論、サイバーセキュリティの3領域において、現行最上位モデルであるClaude Opus 4.6を明確に上回る性能が示されていた。特にソフトウェアプログラミングでは、複雑なコードベース全体の理解と修正タスクでの精度向上が顕著だったとされる。学術推論においては、数学オリンピックレベルの問題や科学論文の批判的分析で、これまでのモデルでは到達できなかった正答率を記録したという。

コードネーム「Capybara」の由来は不明だが、Anthropicが動物名をコードネームに使うのはClaude内部開発では一般的な慣習のようだ。名前の可愛らしさとは裏腹に、その能力は相当なものと見てよい。

サイバーセキュリティ——能力と脅威の両面

ここからが、今回の流出で最も議論を呼んでいる部分だ。

Claude Mythosはサイバーセキュリティ分野で突出した性能を示す一方で、Anthropic自身がそのリスクを深く認識していることが流出資料から読み取れる。ドラフト記事には「前例のないサイバーセキュリティリスク」という表現が含まれており、モデルの能力が攻撃側に転用された場合の影響について、かなり慎重な評価がなされていた。

具体的には、脆弱性の発見と悪用コードの生成において、既存のどのAIモデルよりも高い能力を持つことが社内テストで確認されたとされる。これは防御側にとっては強力なツールになる反面、悪意ある利用者の手に渡れば深刻な脅威となる。

この両義性を踏まえて、Anthropicは当面の提供範囲をサイバーセキュリティ防御に特化した限定的な顧客に絞る方針を固めたようだ。政府機関や大手セキュリティ企業など、厳格なアクセス管理が可能な組織への限定提供を想定しているとみられる。

率直に言えば、この判断は妥当だと思う。だが同時に、こうした「限定提供」がどこまで実効性を持つかには疑問もある。モデルの重みが流出する事態——まさに今回のデータ漏洩のような形で——が起きれば、提供範囲の制限は意味をなさなくなる。

AI企業のセキュリティ管理という皮肉

今回の件で見過ごせないのは、「AIの安全性」を標榜する企業がデータ管理の基本で失敗したという事実だ。

Anthropicは設立以来、AIの安全性研究をミッションの中核に据えてきた。Constitutional AI(憲法AI)のアプローチや、モデルの危険な能力に対する段階的な制限措置など、業界で最も慎重なスタンスを取ってきた企業の一つだ。その企業が、クラウドストレージの公開設定という、セキュリティの初歩中の初歩で躓いた。

もちろん、設定ミスは人間が関わるシステムであれば必ず起こりうる。だがAI企業、特にAnthropicのようにモデルの安全性を差別化要因にしている企業にとって、この種のインシデントは信頼性に直結する。今後「Mythosは安全に管理されている」と主張する際に、今回の流出は確実に引き合いに出されるだろう。

一方で、流出した情報がモデルの重み自体ではなくブログ記事のドラフトだったことは、不幸中の幸いとも言える。モデルそのものが流出していた場合の影響は、比較にならないほど大きかったはずだ。

OpenAI GPT-5.4、Google Geminiとの競争への影響

Claude Mythosの存在が明らかになったことで、AI最前線の競争はさらに激化する。

OpenAIは2026年初頭にGPT-5.4をリリースし、推論能力とマルチモーダル対応で大幅な進化を遂げている。Google DeepMindのGeminiシリーズも2.5 Proで研究者からの評価が高まっている。この2社に対して、Anthropicがどの程度の差をつけられるかが焦点になる。

流出したベンチマーク結果が正確であれば、Claude MythosはGPT-5.4やGemini 2.5 Proと同等以上の性能を持つことになる。特にコーディングとサイバーセキュリティの領域では、明確な優位性を主張できる可能性がある。

だが、ベンチマークの数字だけでは市場での勝敗は決まらない。OpenAIにはChatGPTという圧倒的なユーザーベースがあり、Googleには検索やクラウドとの統合という武器がある。Anthropicが限定提供から始める戦略を取る以上、広範な市場浸透には時間がかかる。

個人的に注目しているのは、サイバーセキュリティ特化という提供戦略だ。汎用AIの競争が消耗戦になりつつある中で、特定領域で圧倒的な優位性を確立するのは、ビジネス的にも合理的な選択に見える。防衛・セキュリティ分野は契約単価が高く、AI企業の収益性改善にも寄与するだろう。

今後の注目ポイント

まず、Anthropicがこの流出にどう対応するかが重要だ。正式発表のタイミングを前倒しするのか、それとも予定通りのスケジュールを維持するのか。流出情報が市場に出回っている以上、沈黙を続けるのは得策ではないだろう。

次に、Claude Mythosの限定提供がどの程度の範囲で行われるか。サイバーセキュリティ防御に絞るという方針は理解できるが、具体的にどの組織が、どのような条件でアクセスできるのかが明らかになれば、このモデルの位置づけがより鮮明になる。

そして最も根本的な問いとして、AI企業は自社が開発する高度なAIシステムを、本当に安全に管理できるのかという問題がある。今回はブログ記事の流出で済んだが、モデルの重みやトレーニングデータが流出した場合の影響ははるかに甚大だ。AI能力の向上と、それを取り巻くセキュリティ体制の強化は、車の両輪であるべきだろう。

Claude Mythosが本当にAnthropicの言う「ステップチェンジ」を実現しているなら、AI業界は新たな段階に入ることになる。だがその発覚の仕方が、データ漏洩という形であったことは、この業界全体が向き合うべき課題を浮き彫りにしている。

Sources:

- Exclusive: Anthropic 'Mythos' AI model representing 'step change' in power revealed in data leak | Fortune

- Anthropic Just Leaked Upcoming Model With "Unprecedented Cybersecurity Risks" in the Most Ironic Way Possible | Futurism

- Anthropic's massive 'Claude Mythos' leak sends software... | CoinDesk

- Details leak on Anthropic's "step-change" Mythos model | Techzine Global

- Anthropic leak reveals new model "Claude Mythos" with "dramatically higher scores on tests" than any previous model | The Decoder