Anthropicが国防総省を提訴——AI倫理をめぐる「踏み絵」にOpenAI・Google社員が反応

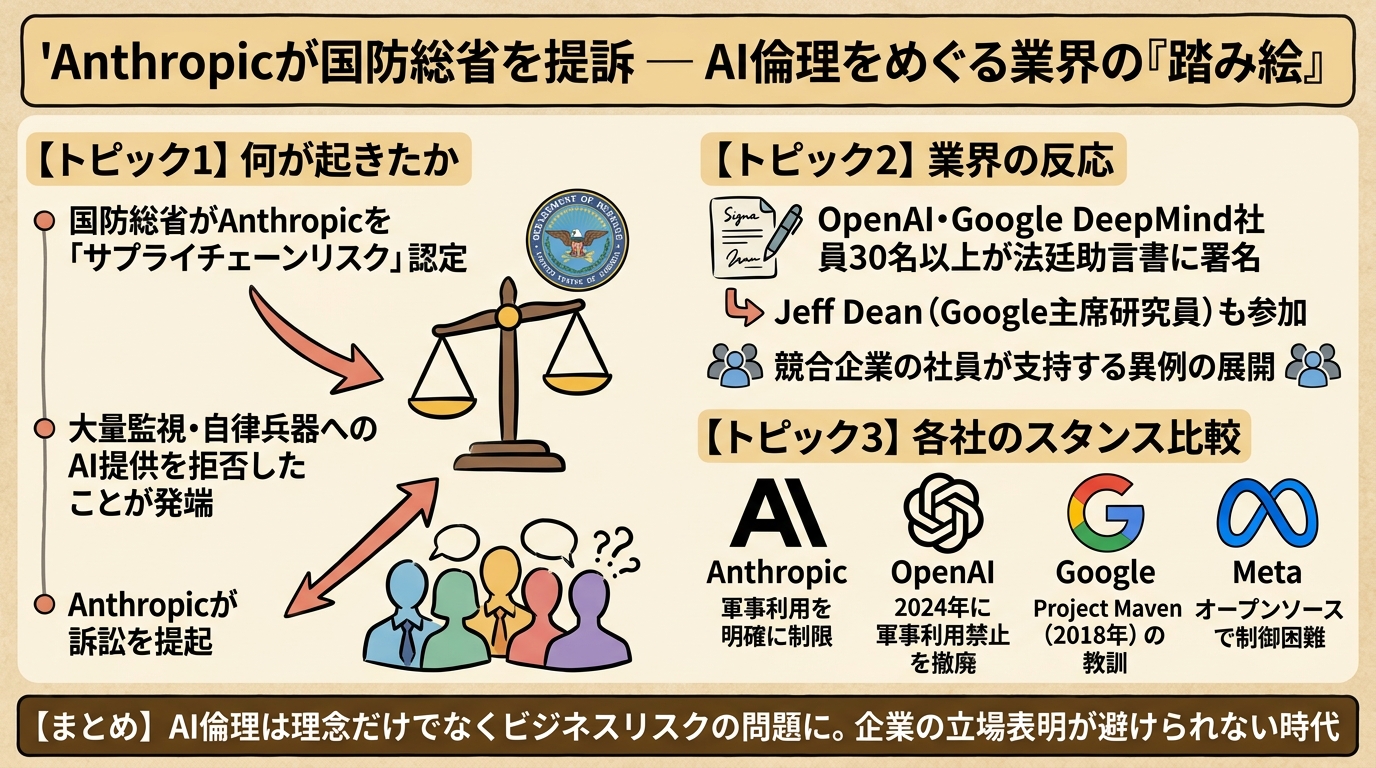

Anthropicが米国国防総省(DoD)を相手に訴訟を起こした。国防総省がAnthropicを「サプライチェーンリスク」としてブラックリストに登録し、政府調達から事実上排除したことに対する法的な異議申し立てだ。

この訴訟が注目を集めているのは、単なる企業と政府の紛争にとどまらないからだ。OpenAIとGoogle DeepMindの従業員30名以上が、Anthropicを支持する法廷助言書(アミカスブリーフ)に署名した。Google DeepMindの主席研究員であるJeff Deanの名前も含まれている。AI企業の倫理的なスタンスをめぐって、業界内部から声が上がる異例の展開だ。

何が起きたのか——経緯を整理する

事の発端は、国防総省がAnthropicのClaudeを政府機関向けのAI調達プログラムから排除したことにある。

国防総省は、Anthropicを「サプライチェーンリスク」と認定した。通常、この分類はサイバーセキュリティ上の懸念がある外国企業——たとえばHuaweiのような——に対して適用されるものだ。米国企業であるAnthropicに適用されたことは前例がなく、業界に衝撃が走った。

この認定の背景にあるのは、Anthropicが国防総省の複数の要請を拒否したことだ。具体的には、大量監視システムへのAI技術の提供、および自律的な兵器システムへのClaudeの組み込みを断った。Anthropicの利用規約(Acceptable Use Policy)は、軍事的な用途に対して明確な制限を設けており、同社はその方針を曲げなかった。

国防総省の立場は明確だ。国家安全保障に資するAI技術へのアクセスを、一民間企業の倫理方針によって制限されることは許容できない——という論理である。

Anthropicは2026年3月中旬に連邦裁判所に訴訟を提起。ブラックリスト登録の取り消しと、恣意的な調達排除の違法性の認定を求めている。

OpenAI・Google社員による法廷助言書の衝撃

この訴訟をめぐる最も注目すべき動きは、競合企業の従業員たちがAnthropicの側に立ったことだ。

OpenAIとGoogle DeepMindの従業員30名以上が、Anthropicを支持する法廷助言書に署名した。法廷助言書とは、訴訟の当事者ではない第三者が裁判所に提出する意見書であり、法的拘束力はないが、裁判所の判断に影響を与えうる。

署名者の中にはGoogleの主席研究員であるJeff Deanが含まれている。Dean氏はTransformerアーキテクチャの開発に関わった計算機科学の世界的権威であり、Google DeepMindの技術面でのリーダーだ。彼が個人の資格とはいえAnthropicを支持したことのインパクトは大きい。

法廷助言書の主旨は、「AI企業が倫理的な利用制限を設けることは、AIの安全性を確保するうえで不可欠であり、政府がそれを理由に企業を罰することは、業界全体の安全基準を引き下げる」というものだ。

個人的には、この動きに驚いた。OpenAIは国防総省やCIAと積極的に連携しており、軍事・安全保障分野でのAI活用に前向きな姿勢を示している。その従業員が、軍事利用を制限するAnthropicの方針を支持するのは、自社の経営方針と矛盾するように見える。だが署名者の多くは研究者やエンジニアであり、経営層ではない。AI研究コミュニティにおける倫理意識と、企業の事業戦略との間にある溝が、可視化された瞬間だ。

AI企業の軍事利用に対するスタンスの分岐

この訴訟を理解するには、主要AI企業の軍事利用に対するスタンスの違いを把握する必要がある。

OpenAIは2024年に利用規約を改定し、「軍事・戦争」用途の禁止条項を削除した。以降、国防総省やCIAとの契約を公表し、サイバーセキュリティや情報分析の分野でAI技術を提供している。CEOのSam Altmanは「民主主義国家の安全保障に貢献することは責任ある行動だ」と述べている。

Googleは2018年の「Project Maven」問題——ドローン映像の分析にAIを使う国防総省プロジェクト——で従業員の大規模な抗議を受け、国防総省との契約を打ち切った経緯がある。その後、方針を段階的に修正し、現在は「攻撃的な兵器」以外の軍事用途には門戸を開いている。ただし社内には依然として慎重な声が多く、Jeff Deanの署名はその空気を反映しているとも読める。

Anthropicは創業時から「AIの安全性」を企業のアイデンティティの中核に据えてきた。軍事利用に対する制限は最も厳格で、大量監視や自律兵器への技術提供を明確に拒否している。今回の訴訟は、その方針を法廷で守ろうとする試みだ。

MetaはLlamaモデルをオープンソースで公開しており、軍事利用を含む用途の制限は限定的だ。事実上、誰でも軍事応用が可能な状態にある。

こうして並べてみると、AI企業の軍事利用に対するスタンスは4社4様だ。完全拒否のAnthropic、積極協力のOpenAI、条件付き協力のGoogle、そして事実上の無制限公開のMeta。この違いが、今後の政府調達や規制の方向性に直接影響を及ぼすことになる。

「踏み絵」としての意味

率直に言えば、この訴訟はAI業界全体にとっての「踏み絵」だ。

国防総省がAnthropicをブラックリストに載せたことは、メッセージとして明確だ——「政府の要請に応じないAI企業は、政府調達市場から排除される」。米国政府のAI関連支出は年間数百億ドル規模であり、この市場へのアクセスを失うことは、どのAI企業にとっても痛手だ。

一方、Anthropicの訴訟と法廷助言書は別のメッセージを発している——「倫理的な制限を設けることで罰せられるなら、どの企業も安全性に投資するインセンティブを失う」。

この構図は、テック業界にとって既視感がある。2018年のGoogle Project Mavenの騒動、2010年代のNSA監視プログラムへのテック企業の協力問題、そして遡ればベトナム戦争時代の軍産複合体への批判。テクノロジーと軍事の関係は、何度も同じ問いを投げかけてくる。

ただし今回は状況が異なる。汎用AIは従来のソフトウェアとは違い、一度展開されると極めて広範な用途に転用できる。監視カメラの映像分析に使われるモデルと、カスタマーサポートに使われるモデルが、基盤としては同じものであるという事実が、線引きを難しくしている。

テック業界の内部分断

法廷助言書に署名した30名以上の従業員と、その雇用主であるOpenAIやGoogleの経営方針の間にある温度差は、見過ごせない。

OpenAIでは、軍事・安全保障分野への進出を経営戦略の柱の一つとして位置づけている。社員の一部がそれに異を唱えているという構図は、2018年のGoogle内部の騒動と重なる。当時、Google社員4000人以上がProject Mavenへの抗議書簡に署名し、数十人が退職した。

今回の法廷助言書の署名者が所属企業内でどのような立場に置かれるかは、今後注視すべきだ。米国では従業員の政治的表現は一定の保護を受けるが、AIの軍事利用という問題が社内政治にどう作用するかは予測しにくい。

個人的には、この分断はAI業界の成熟を示すものだと考えている。業界が小さいうちは「全員が同じ方向を向く」ことが可能だが、AIが国防、医療、教育、金融のあらゆる分野に浸透する段階では、価値観の多様性——そして衝突——は避けられない。

裁判の行方と業界への影響

裁判の結果がどうなるかは現時点では予測が難しい。ただし、いくつかのシナリオを整理しておく。

Anthropicが勝訴した場合、AI企業が倫理的な利用制限を設けることが法的に保護される前例となる。政府は、企業の方針を理由に調達から排除することが難しくなる。これは業界全体の安全基準を底上げする方向に作用するだろう。

国防総省が勝訴した場合、政府調達に参加したいAI企業は、軍事利用を含む幅広い用途に技術を提供する圧力にさらされる。安全性を重視する企業は、政府市場と倫理方針のどちらかを選ぶことを迫られる。

和解の場合、表面的には問題が解決するが、根本的な問いは先送りされる。

いずれにせよ、この訴訟はAIの軍事利用に関する法的枠組みの形成に大きな影響を与えるだろう。AI安全性の議論が、学術論文やカンファレンスの会場から法廷に移ったことは、この問題がもはや「議論のテーマ」ではなく「現実のビジネスリスク」であることを意味している。

正直なところ、正解のない問いだ。国家安全保障と倫理的制限のどちらが優先されるべきかは、立場によって答えが変わる。だがAnthropicが法廷でその問いを正面から争う姿勢を見せたこと、そして競合企業の研究者たちがそれを支持したことは、AI業界にとって重要な転機になるだろう。

Sources:

- Anthropic sues the Trump administration over 'supply chain risk' label | NPR

- Anthropic sues Defense Department over supply-chain risk designation | TechCrunch

- Judge blocks Pentagon's effort to 'punish' Anthropic by labeling it a supply chain risk | CNN Business

- Anthropic wins preliminary injunction in DOD fight as judge cites 'First Amendment retaliation' | CNBC

- Google and OpenAI employees back Anthropic in its legal fight with the Pentagon | Fortune

- OpenAI and Google employees rush to Anthropic's defense in DOD lawsuit | TechCrunch