Wikipedia、AI生成コンテンツを原則禁止——44対2の圧倒的多数で採択されたガイドラインの中身

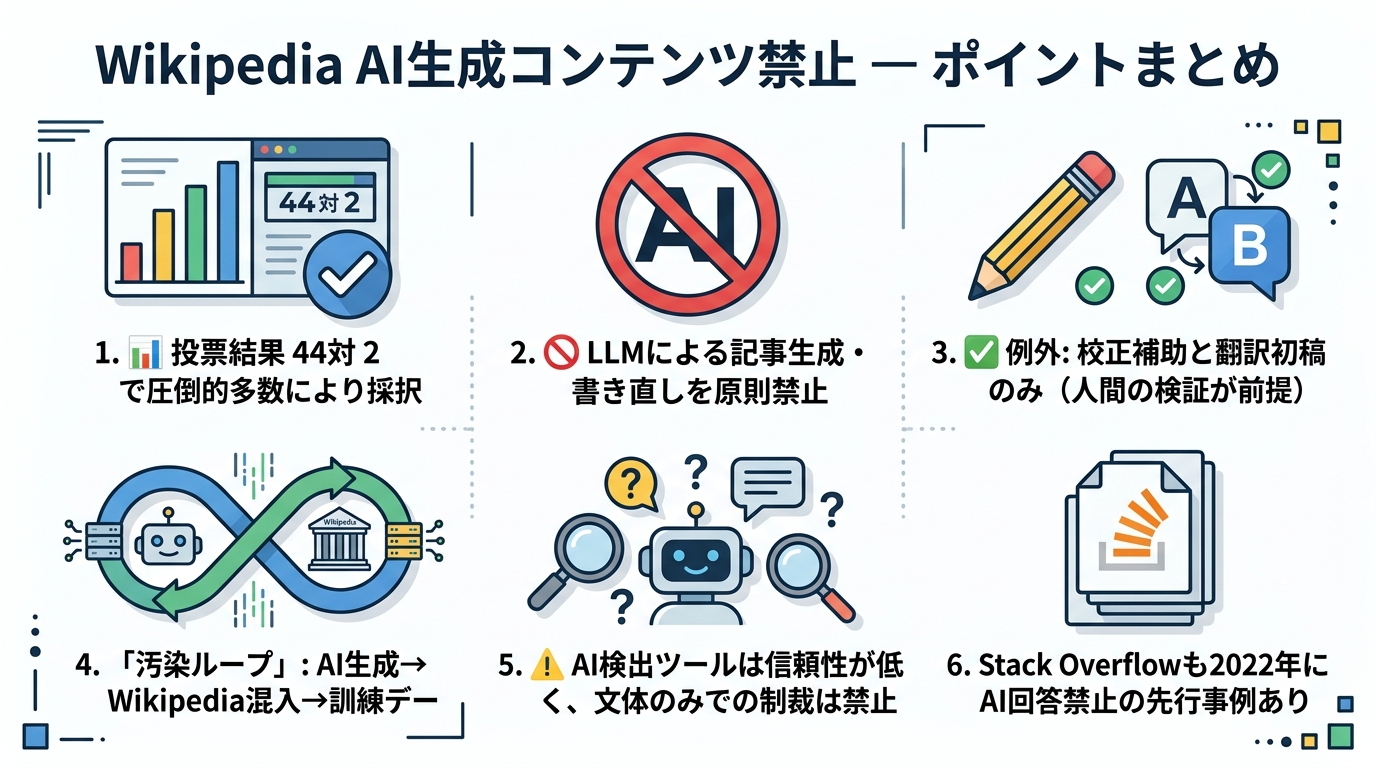

2026年3月20日、英語版Wikipediaの編集者コミュニティが、大規模言語モデル(LLM)を使った記事生成を原則禁止するガイドラインを正式採択した。投票結果は44対2。ほぼ全会一致と言っていい数字だ。インターネット上で最大規模の百科事典が、AI生成コンテンツに対して明確な「No」を突きつけた瞬間である。

44対2——議論の余地がない数字

今回の意思決定プロセスは「Request for Comment(RfC)」と呼ばれるWikipedia独自の合意形成手続きによるものだ。管理者のChaotic Enbyが提案を取りまとめ、3月20日に投票が締め切られた。44票の賛成に対し、反対はわずか2票。合意があまりに明確なため、Wikipedia内の慣例である「WP:SNOW(雪玉条項)」——つまり結果が雪玉のように見えるほど明らかな場合に早期決着させるルール——が適用され、スピーディーに確定した。

率直に言えば、この数字には少し驚いた。AI活用をめぐる議論では、肯定派と懐疑派が拮抗するケースが多い。しかしWikipediaの編集者コミュニティにおいては、懸念がほぼ共有されていたということだろう。

何が禁止され、何が許容されるのか

ガイドラインが禁じるのは、LLMを使って記事のコンテンツを「生成」または「書き直す」行為全般である。ChatGPTやClaudeに「Wikipedia記事を書いて」と指示して出力されたテキストをそのまま投稿すること、あるいは既存記事をLLMに渡して全面的に言い換えさせることが、明確にアウトとなった。

例外は2つだけ認められている。1つ目は、自分が書いた文章の基本的な校正補助として使うこと。2つ目は、機械翻訳の初稿生成に利用すること。ただしいずれも「LLMの出力をそのまま使う」わけではなく、編集者が内容を確認し責任を持って検証することが前提だ。翻訳の場合も、LLMが意図せず文意を変えてしまうリスクがあるため、最終的な確認は人間が行わなければならない。

ここで気になるのは、「校正補助」と「コンテンツ生成」の境界線がどこにあるかという点だ。現時点でWikipediaが示す基準はやや曖昧で、実際の運用に委ねられる部分も大きい。

「汚染ループ」という構造的脅威

コミュニティがこれほど強くAI生成コンテンツを拒んだ背景には、単純な「品質問題」以上の懸念がある。

LLMはハルシネーション——存在しない引用文献の捏造、不正確な事実の自信満々な記述——を起こすことが知られている。Wikipediaのようなプロジェクトにとって、出典のない記述や架空の参考文献は致命的だ。しかしそれだけではない。問題は、そのハルシネーションを含んだコンテンツがWikipediaに混入した場合に何が起きるか、という連鎖反応にある。

Wikipediaは現在もAI企業の訓練データとして広く使われている。不正確なAI生成テキストがWikipediaに入り込み、それが次世代モデルの学習に使われれば、より洗練された「嘘」が産み出される。その「嘘」がまたWikipediaに紛れ込む——いわゆる「データ汚染ループ」だ。信頼性こそが生命線のWikipediaにとって、この負の連鎖を断ち切ることは急務だった。

執行の難しさ:「文体だけでは判断できない」

ガイドラインには現実的な留保も盛り込まれている。AIが生成したテキストを確実に検出するツールは「現時点では信頼性が低い」という認識だ。

つまり、編集者がAIを使ったかどうかを、文体や言語的特徴だけで断定することはできない。人間がAIに似た書き方をすることもあれば、AIが人間らしい文章を書くこともある。そのため、ガイドラインは「文体上の特徴のみを根拠にした制裁は行わない」と明記している。代わりに編集者は、コンテンツがWikipediaのポリシー(検証可能性、中立的観点など)に準拠しているかどうか、および該当ユーザーの編集履歴を総合的に判断材料とする。

正直なところ、この執行方針には課題が残る。AI生成コンテンツの投稿には数秒しかかからないのに、それを検証・除去するには数時間かかる——この非対称性は、ボランティア主体のWikipediaコミュニティにとって無視できない負担だ。

Stack Overflowとの比較——先行事例が示す教訓

AI生成コンテンツの制限に動いたプラットフォームは、Wikipediaが初めてではない。Stack Overflowは2022年末、ChatGPT登場直後に「AI生成回答の一時禁止」を宣言している。当時、もっともらしいが間違ったコードの回答が大量に投稿され、サイトの信頼性を急激に損なったのが直接の引き金だった。

ドイツ語版Wikipediaなど他言語版では、すでに類似の方針を先行して設けていた実績もある。英語版の今回の採択が注目を集めているのは、その規模と影響力の大きさによる。英語版Wikipediaは月間約20億ページビューを誇り、世界中のAI訓練データセットに最も広く取り込まれているウェブコンテンツの一つだ。

個人的には、この「44対2」という投票結果は、編集者たちが何年もかけて感じてきた疲弊の表れでもあると思う。人海戦術で築いてきた百科事典が、AIのテキスト生成に一瞬で飲み込まれる恐怖——それは実に切実なものだろう。

「知識のインフラ」を守る選択

英語版Wikipediaの今回の決定は、プラットフォームがAI生成コンテンツに対してどう向き合うかという、より大きな問いの一つの回答例となった。

「AIが書いたものを人間がチェックすれば品質は保てる」という考え方もある。しかしWikipediaのコミュニティが選んだのは、「そもそも入口で止める」という方針だ。検証コストの非対称性、ハルシネーションによるデータ汚染リスク、ボランティアリソースの限界——これらを総合的に判断した結果として、44対2という数字は重く受け止めるべきだろう。

AIと人間が協働する形での知識生産のあり方は、まだ模索中だ。しかしWikipediaが打ち出したこの明快な線引きは、他のプラットフォームやコミュニティが自らの方針を考える上での重要な参照点になる。

Sources:

- Wikipedia cracks down on the use of AI in article writing | TechCrunch

- Wikipedia Bans AI-Generated Content | 404 Media

- Wikipedia Bans AI-Written Articles in 44-2 Editor Vote | implicator.ai

- Wikipedia bans AI-generated article content after RfC | MediaNama

- Wikipedia Bans AI-Generated Text in Articles Under New Editing Policy | Decrypt